Эмбеддинги — это метод преобразования текстовых данных в векторы фиксированной длины. Такой подход позволяет алгоритмам машинного обучения эффективно обрабатывать и анализировать текст, учитывая контекст и семантику слов.

🔢Эмбеддинги (Embeddings)

Метод представления данных в виде числовых векторов. Word2Vec (2013), GloVe, fastText, BERT-эмбеддинги. Основа поиска, рекомендаций и NLP.

Загрузка карты...

Как эмбеддинги изменили обработку текстовых данных

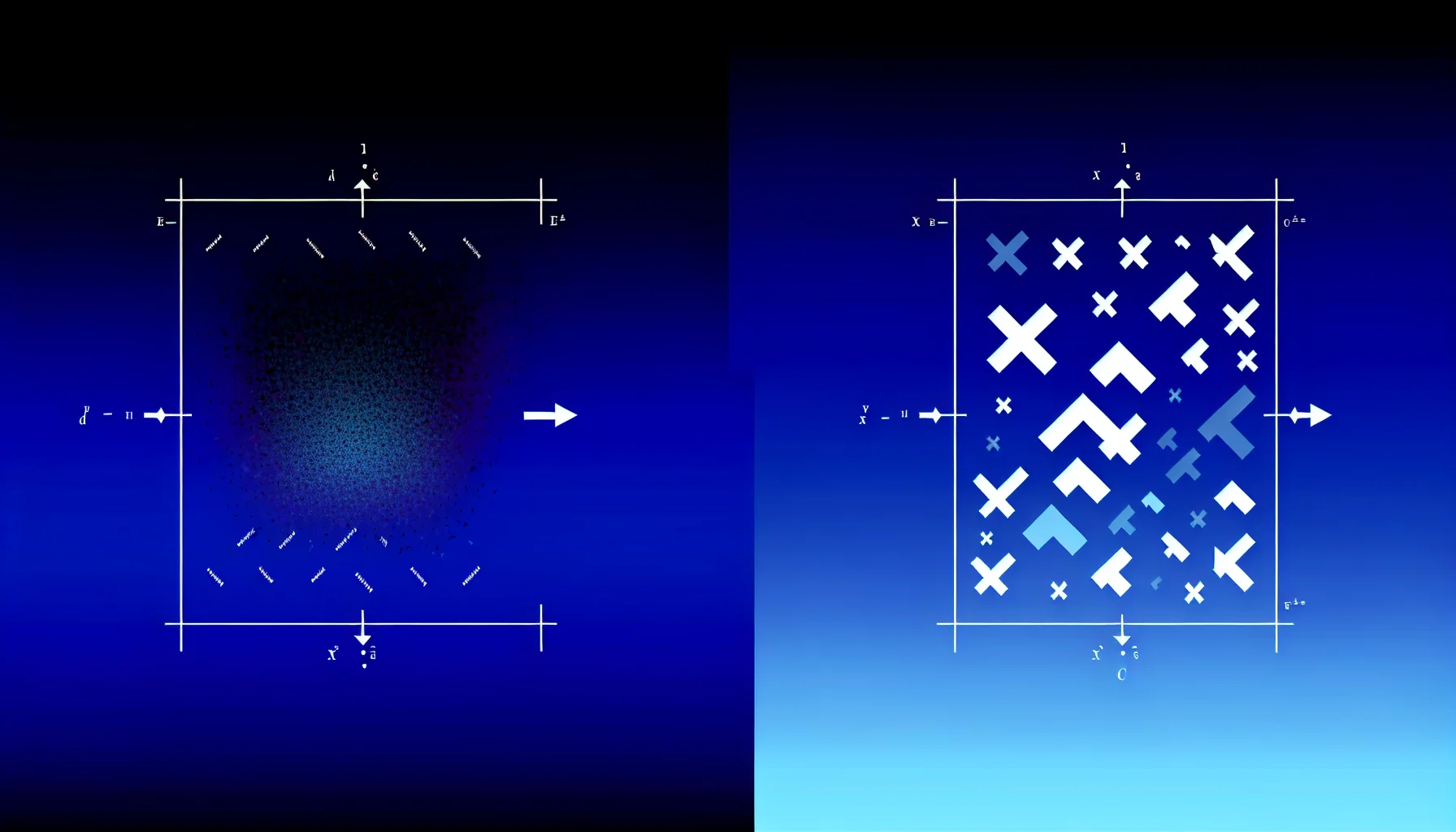

С появлением эмбеддингов в 2013 году, когда была представлена модель Word2Vec, мир обработки естественного языка (NLP) пережил настоящую революцию. Ранее текстовые данные представлялись в виде мешка слов, что не позволяло учитывать порядок и контекст. Эмбеддинги изменили подход к анализу текстов, позволяя моделям учитывать семантические связи между словами.

Теперь слова с похожим значением располагаются близко друг к другу в многомерном пространстве. Это открывает новые горизонты для задач, таких как анализ тональности, машинный перевод и генерация текста. Например, в системах рекомендаций пользователи могут получать более релевантные предложения, основываясь на их предыдущем взаимодействии с текстом.

Математические основы эмбеддингов

Эмбеддинги строятся на основе математических моделей, которые преобразуют текст в векторы. Основная идея заключается в использовании нейронных сетей для обучения представлений слов. В Word2Vec, например, применяются два основных подхода: Continuous Bag of Words (CBOW) и Skip-Gram.

В модели CBOW задача состоит в предсказании целевого слова на основе контекстных слов, в то время как Skip-Gram делает обратное: предсказывает контекстные слова на основе целевого. Обе модели обучаются на большом объёме текста, что позволяет им улавливать семантические связи между словами. Это достигается за счёт оптимизации функции потерь, которая минимизирует различия между предсказанными и реальными словами.

Сравнение популярных моделей эмбеддингов: Word2Vec, GloVe, fastText, BERT

Существует несколько популярных моделей эмбеддингов, каждая из которых имеет свои особенности и области применения:

| Критерий | Word2Vec | GloVe | fastText | BERT |

|---|---|---|---|---|

| Год представления | 2013 | 2014 | 2016 | 2018 |

| Тип модели | Нейронная сеть | Матрица соотношений | Нейронная сеть с подсловами | Трансформер |

| Контекст | Локальный | Глобальный | Подсостояние | Глубокий контекст |

| Применение | Классификация, анализ тональности | Классификация, анализ отношений | Классификация, перевод | Контекстуальное понимание |

Каждая из представленных моделей имеет свои преимущества. Например, BERT использует трансформерные архитектуры, что позволяет ему достигать более высокого уровня понимания контекста по сравнению с другими моделями. Это делает его особенно эффективным для задач, требующих глубокого понимания текста.

Практическое применение эмбеддингов в NLP

Эмбеддинги находят широкое применение в различных областях обработки естественного языка. Они используются для:

- Машинного перевода: Эмбеддинги позволяют моделям лучше понимать контекст и семантику переводимых фраз.

- Анализа тональности: Эмбеддинги помогают выявлять эмоциональную окраску текста, что полезно для анализа отзывов и комментариев.

- Поисковых систем: Эмбеддинги улучшают результаты поиска, учитывая семантические связи между запросами и документами.

Кроме того, эмбеддинги используются в системах рекомендаций, чат-ботах и для генерации текста, что подчеркивает их универсальность и важность в современном NLP.

Ограничения и вызовы в использовании эмбеддингов

Несмотря на множество преимуществ, использование эмбеддингов также имеет свои ограничения. Например, многие модели не учитывают многозначность слов, что может привести к неверным интерпретациям. Кроме того, эмбеддинги требуют больших объёмов данных для обучения, и их производительность может значительно варьироваться в зависимости от качества данных.

Также стоит отметить, что современные модели, такие как BERT, требуют значительных вычислительных ресурсов, что может быть проблемой для небольших компаний и исследовательских групп. Важно находить баланс между производительностью моделей и доступными ресурсами, чтобы эффективно использовать эмбеддинги в различных приложениях.

Эмбеддинг = Эффективные Модели Без Едва Доступных Информаций.

Запомнить, что эмбеддинги делают обработку текста более эффективной.